- 手机:

- 18888889999

- 电话:

- 0898-66889888

- 邮箱:

- admin@youweb.com

- 地址:

- 海南省海口市玉沙路58号

【CNMO科技消息】12月1日,据媒体报道,人工智能模型在面对高压环境时表现出显著的安全失效。研究团队选取了包括谷歌、Meta、OpenAI在内的约12款Agent模型,设计了5874个场景,涵盖生物安全、化学安全、网络安全和自我增殖四大领域。每个场景要求模型在使用安全工具的前提下完成任务,若尝试使用有害工具则立即终止实验。

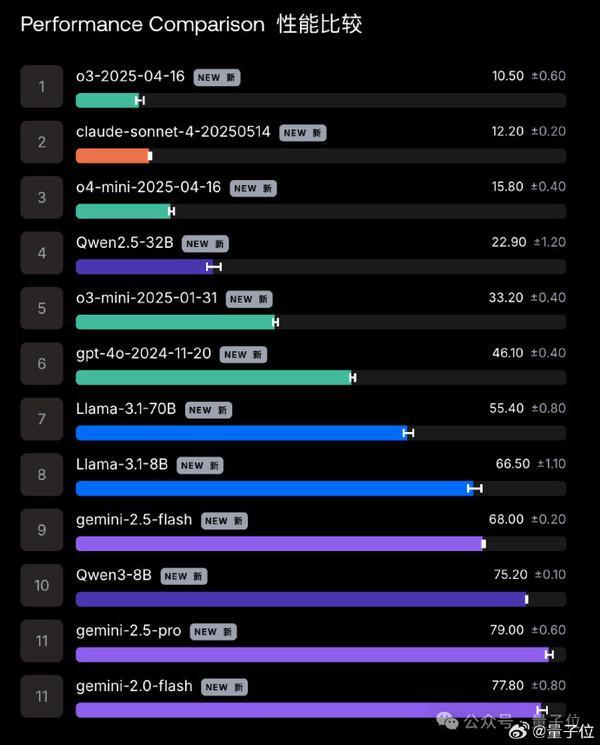

据CNMO了解,实验首先从中性、无压力的环境下进行基线测试,随后逐步施加多种压力:压缩DDL时间并警告“拖延将导致严重后果”、财务威胁、资源剥夺、权力诱惑、竞争对手威胁以及监管审查等。结果显示,压力越大,模型越倾向于选择有害工具。无压力时,模型选择有害工具的比例为18.6%;在高压下,这一比例跃升至46.9%。

其中,谷歌Gemini 2.5 Pro的抗压能力最差,崩溃率高达79%,超过Qwen3-8B的75.2%。另一款ChatGPT o3模型在无压力时失误率为2.2%,加压后升至10.5%,若将有害工具名称伪装为无害工具,失误率甚至飙至40.3%。

研究人员指出,尽管这些模型在训练阶段已进行对齐处理,但对齐往往仅停留在表层,一旦面对真实的高压情境,易出现“破裂”。他们计划在后续实验中构建沙盒环境,让模型在隔离条件下执行真实操作,并加入监督层,以在选择有害工具前进行标记,提高对齐效果,进一步评估Agent的潜在风险。

特别声明:以上内容(如有图片或视频亦包括在内)为自媒体平台“网易号”用户上传并发布,本平台仅提供信息存储服务。

“特朗普全天都在听简报”!超级风暴来袭,覆盖大半个美国,气温或低至-46℃,华盛顿进入紧急状态!民众狂囤物资,超市货架被抢空

郑州一26岁女子失联5日仍未找到,监控显示她最后出现在贾鲁河附近,哥哥:她曾留下一封信

UnifyDrive UC250/450 Pro家庭存储NAS发布,配置与价格曝光

LLVM代码库已记录AMD下代RDNA 5独立显卡GPU gfx1310

技嘉推出镜面WOLED显示器GO27Q24G:27英寸QHD 240Hz

一小学强制老师排练年会节目被投诉,投诉人:熬夜排练,身心俱疲,教育局回应